텐서 처리 장치

텐서 처리 장치(Tensor Processing Unit, TPU)는 구글에서 2016년 5월에 발표한 데이터 분석 및 딥러닝용 하드웨어이다. 구글 자체 텐서플로 소프트웨어를 이용한다.[1] 구글은 2015년에 내부적으로 TPU를 사용하기 시작했으며 2018년 서드파티용으로 판매를 시작했다.

| 설계 기업 및 설계자 | 구글 |

|---|---|

| 발표 | 2016년 5월 |

| 유형 | 신경망 기계 학습 |

벡터/행렬연산의 병렬처리에 특화되어 있으며 엄청난 전성비를 자랑한다.

제품

편집| TPUv1 | TPUv2 | TPUv3 | TPUv4[2] | Edge v1 | |

|---|---|---|---|---|---|

| 도입일 | 2016 | 2017 | 2018 | 2020 | |

| 가공 노드 | 28nm | 20nm? | 12nm? | ? | |

| 다이 크기 (mm2) | 331 | ? | ? | ? | |

| 온 칩 메모리 (MiB) | 28 | ? | ? | ? | |

| 클럭 속도 (MHz) | 700 | ? | ? | ? | |

| 메모리 (GB) | 8GB DDR3 | 16GB HBM | 32GB HBM | ? | |

| TDP (W) | 40 | 200 | 250 | ? | |

| TOPS | 23 | 45 | 90 | ? |

같이 보기

편집각주

편집- ↑ “Cloud Tensor Processing Units (TPUs)”. 《Google Cloud》. 2020년 7월 20일에 확인함.

- ↑ Stay tuned, more information on TPU v4 is coming soon, Retrieved 2020-08-06.

외부 링크

편집- Cloud Tensor Processing Units (TPUs) (Documentation from Google Cloud)

- Photo of Google's TPU chip and board

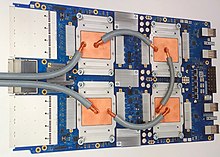

- Photo of Google's TPU v2 board

- Photo of Google's TPU v3 board

- Photo of Google's TPU v2 pod

| 이 글은 기술에 관한 토막글입니다. 여러분의 지식으로 알차게 문서를 완성해 갑시다. |